Create an account

Welcome! Register for an account

La password verrà inviata via email.

Recupero della password

Recupera la tua password

La password verrà inviata via email.

-

- container colonna1

- Categorie

- #iorestoacasa

- Agenda

- Archeologia

- Architettura

- Arte antica

- Arte contemporanea

- Arte moderna

- Arti performative

- Attualità

- Bandi e concorsi

- Beni culturali

- Cinema

- Contest

- Danza

- Design

- Diritto

- Eventi

- Fiere e manifestazioni

- Film e serie tv

- Formazione

- Fotografia

- Libri ed editoria

- Mercato

- MIC Ministero della Cultura

- Moda

- Musei

- Musica

- Opening

- Personaggi

- Politica e opinioni

- Street Art

- Teatro

- Viaggi

- Categorie

- container colonna2

- container colonna1

14

giugno 2016

Intelligenza artificiale fuori di testa

Il fatto

Che gli umani siano esseri socialmente pericolosi lo scopriamo da millenni ogni giorno, ma che un robot possa ferire volontariamente, e arbitrariamente, non si era ancora visto. Fino ad oggi, smentendo il romanziere Asimov e mettendo in guardia i tecnocrati di sempre

di redazione

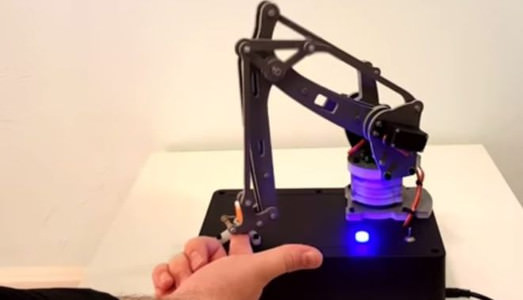

Appassionati di robotica? Blade Runner, Gattaca e affini? Bene, sappiate che d’ora in poi l’inceppo dell’intelligenza artificiale potrebbe non essere più un caso, ma una programmazione arbitraria messa a punto per fare male volontariamente (e inconsapevolmente) all’uomo. Magari perfino allo stesso creatore.

L’esperimento viene dall’Università californiana di Berkley dove l’ingegnere (che ama definirsi artista, chissà perché) Alexander Reben, ha messo in crisi la prima legge di Isaac Asimov: lo scrittore di fantascienza affermava infatti che un robot non può fare del male ad un essere umano.

In realtà da quando sono stati concepiti i droni in diverse occasioni si è tentato di mettere a punto congegni robotici dotati di intelligenza (e cattiveria, difesa, attacco, chiamatela come volete) autonoma. Chissà, forse anche un modo per lavare le nostre coscienze pavide: se un drone, un robot o chi per lui ragiona da solo sarà facile, in caso di errori, processarlo sommariamente, eliminarlo, resettarlo. Con il dispositivo di Reben si può dire che la macchina abbia raggiunto la sua più vicina forma di umanità, almeno attualmente: il braccio può scegliere se pungere o no un dito provocando una piccola ferita: l’intelligenza artificiale decide arbitrariamente se far partire un ago, oppure no.

Così, ora, oltre alle spiegazioni che quotidianamente chiediamo a noi stessi e all’umanità, dopo stragi, delitti e affini, potremmo chiedere lumi anche ai robot. Magari non risponderanno, come del resto fanno gli umani. Missione compiuta! (MB)

.jpg)